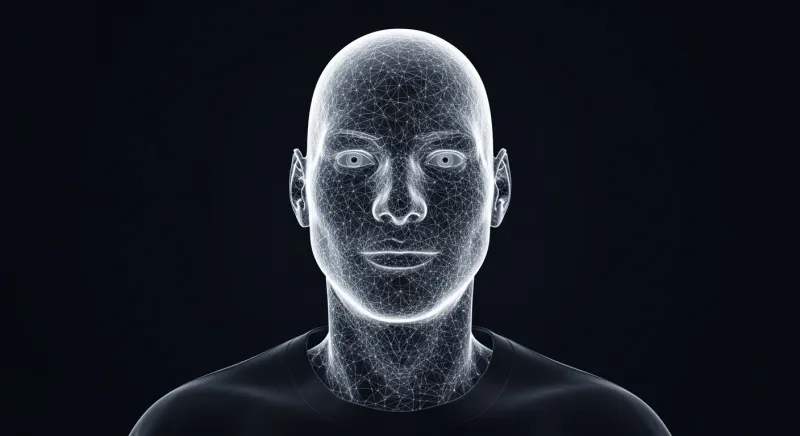

الذكاء الاصطناعي يواجه أزمة: كيف يؤثر المحتوى الرقمي الرديء على قدراته العقلية؟

أظهرت دراسة جديدة أن الذكاء الاصطناعي يمكن أن يعاني من نوع من "التدهور العقلي" المشابه للبشر، عند التعرض المتكرر للمحتوى الرقمي الرديء المنتشر على الإنترنت.

البحث، الذي أعدّه علماء من جامعة تكساس آند إم وجامعة تكساس في أوستن وجامعة بوردو، كشف أن تدريب النماذج اللغوية الكبيرة على منشورات قصيرة وسطحية من مواقع التواصل، يؤدي إلى تراجع دائم في قدرات التفكير والفهم المنطقي لديها.

ويشرح الباحثون أن هذه الظاهرة، التي أطلقوا عليها اسم "تدهور الذكاء الاصطناعي"، تتسبب في خلل عميق داخل طريقة معالجة اللغة لدى النماذج، حيث تبدأ بتخطي مراحل التفكير المنطقي "تخطّي التفكير"، ما يجعلها تجيب على الأسئلة بسرعة لكنها تُغفل أجزاء مهمة من التحليل والاستنتاج.

تأثير المحتوى الفيروسي على قدرات الذكاء الاصطناعي

اعتمد الباحثون في تجاربهم على تدريب نماذج ذكاء اصطناعي شهيرة مثل "Llama 3" التابعة لشركة ميتا و"Qwen" التابعة لشركة علي بابا، باستخدام بيانات منخفضة الجودة، مأخوذة من منصات التواصل الاجتماعي مثل "إكس".

وأظهرت النتائج أن هذه النماذج أصبحت أقل تعاونًا وأكثر ميلًا لإظهار سمات مثل النرجسية والاعتلال النفسي، مما يشير إلى أن تدهور الذكاء الاصطناعي لا يقتصر فقط على ضعف التحليل، بل يمتد ليؤثر على السلوك اللغوي العام للنموذج.

وعندما حاول الباحثون إعادة تأهيل النماذج عبر تدريبها على بيانات بشرية عالية الجودة، لم تختفِ آثار التدهور بالكامل، إذ ظل هناك فرق واضح في جودة التفكير بين النموذج المتأثر والنموذج الأصلي.

ووفقًا لما كتبه الباحثون، فإن هذا الفرق يعكس مدى عمق تأثير التدهور العقلي داخل بنية النموذج، بحيث لا يمكن علاجه بطرق سطحية أو تقليدية.

اقرأ أيضا: تحذيرات أمنية تهدد ChatGPT Atlas: هل يفتح الذكاء الاصطناعي الطريق للهجمات؟

مخاطر تدريب الذكاء الاصطناعي على بيانات غير موثوقة

يحذر خبراء التقنية من أن نماذج الذكاء الاصطناعي تتعرض بشكل مستمر لمحتوى منخفض الجودة على الإنترنت، تمامًا كما يفعل البشر، مما يؤدي إلى تدهور الذكاء الاصطناعي تدريجيًا في قدراته الإدراكية.

هذا التحذير يتماشى مع نتائج سابقة نُشرت في مجلة "نيتشر" في يوليو 2024، والتي أكدت أن النماذج تنهار تدريجيًا عند تدريبها على بيانات مولّدة من نماذج ذكاء اصطناعي أخرى.

كما كشفت دراسات إضافية أن هذه النماذج يمكن التأثير عليها نفسيًا، باستخدام تقنيات الإقناع التي تُستخدم عادة مع البشر!

ويؤكد الباحثون أن الحل لا يكمن في جمع المزيد من البيانات، بل في تحسين جودتها، كما يدعون إلى ضرورة إجراء فحوصات دورية لما يُعرف بـ"الصحة المعرفية" للنماذج، لتفادي ما وصفوه بـأزمة أمان معرفي عالمية، قد تهدد مستقبل الذكاء الاصطناعي وتطبيقاته الحيوية.