ابتكار "آبل" الجديد VSSFlow.. تحويل المشاهد الصامتة إلى واقع مسموع

كشف ثلاثة باحثين من شركة "آبل"، بالتعاون مع 6 باحثين من جامعة "رينمين" الصينية، عن نموذج ذكاء اصطناعي ثوري يسمى "VSSFlow".

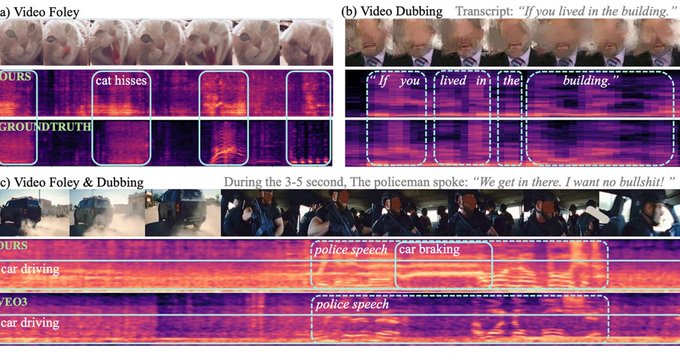

ويهدف هذا الابتكار إلى حل معضلة تقنية مزمنة في عالم الذكاء الاصطناعي؛ حيث كانت معظم النماذج السابقة التي تُدرب لتوليد الصوت من الفيديو الصامت تفتقر إلى الجودة في إنتاج الكلام البشري، بينما تفشل نماذج "تحويل النص إلى كلام" في توليد الأصوات البيئية غير اللفظية كونها صُممت لأغراض مختلفة تمامًا.

ونجحت "آبل" في بناء نظام موحد يدمج المهمتين معًا بأسلوب يقلل من تعقيد العمليات البرمجية المعتادة التي كانت تعتمد سابقًا على مراحل منفصلة لتعليم الكلام والصوت.

آلية عمل نموذج "VSSFlow" الجديد

وتعتمد البنية التحتية لنموذج "VSSFlow" الذي تدعمه شركة "آبل" على بنية مكونة من 10 طبقات تدمج إشارات الفيديو والنصوص المكتوبة مباشرة في عملية توليد الصوت، مما يسمح للنظام بمعالجة المؤثرات الصوتية والخطاب البشري داخل إطار واحد.

ويستفيد النموذج من عدة مفاهيم متقدمة في الذكاء الاصطناعي التوليدي، أبرزها تحويل النصوص المكتوبة إلى تسلسلات من "الفونيمات"؛ وهي الوحدات الصوتية الصغرى التي تشكل نطق الكلمات، مما يضمن محاكاة دقيقة لمخارج الحروف البشرية.

ويستخدم النظام تقنية مبتكرة تُسمى "مطابقة التدفق"، وهي تقنية ذكية تقوم بتنقية الأصوات وتشكيلها تدريجيًا بدءًا من ضجيج عشوائي، وصولًا إلى إنتاج صوت نقي وواقعي تمامًا يطابق المشهد المعروض.

والمثير للاهتمام هو ما كشف عنه باحثو "آبل" من أن التدريب المشترك على الكلام والأصوات المحيطة لم يؤدِّ إلى تراجع الأداء أو حدوث تداخل بينهما، بل على العكس تمامًا، ساهم التدريب على الخطاب البشري في رفع جودة الأصوات البيئية، مما أحدث تأثيرًا إيجابيًا متبادلًا عزز من كفاءة النظام الموحد.

خطوات تطوير نموذج "VSSFlow"

ولتحقيق هذه القدرات الشاملة، خضع نموذج آبل لعملية تدريب مكثفة باستخدام مزيج متنوع من البيانات؛ شملت فيديوهات صامتة مرفقة بأصوات الطبيعة والبيئة، وفيديوهات لأشخاص يتحدثون مع نصوص حواراتهم، بالإضافة إلى أنظمة تحويل النصوص إلى كلام التقليدية.

ورغم أن النموذج لم يتمكن في البداية من دمج الكلام مع أصوات الخلفية في وقت واحد، إلا أن المطورين أجروا عليه عمليات "ضبط دقيق" عبر آلاف الأمثلة الإضافية حتى أتقن مهارة إصدار الصوت والحديث معًا في تناغم تام.

وفي خطوة داعمة للمجتمع التقني، أتاح الفريق البحثي الكود المصدري للنموذج عبر منصة "جيت هاب"، مع مواصلة العمل على تطوير تقنيات تحافظ على أدق تفاصيل النطق البشري رغم صغر حجم الملفات الصوتية.